Amazon, Apple et Google détiennent l’essentiel des parts de marché des assistants vocaux. Avec la révélation récente de leur processus d’examen humain, de nombreux consommateurs sont préoccupés par leur vie privée. Nous avons donc créé cette infographie afin que des personnes comme vous puissent contrôler plus facilement leurs paramètres de vie privée.

Bonjour,

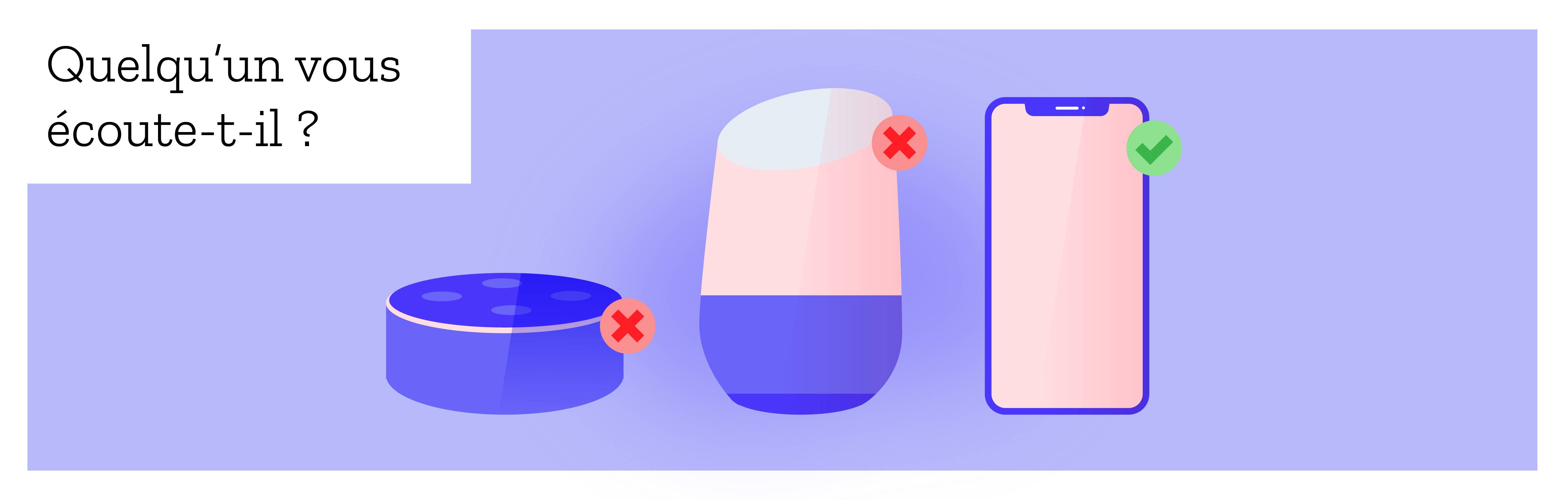

Si vous avez un assistant vocal chez vous ou sur votre téléphone, vous êtes-vous déjà demandé⋅e si un employé de l’entreprise pouvait écouter vos enregistrements vocaux ?

L’actualité des derniers jours confirme ces craintes.

Fin juillet, le Guardian a révélé que des employés d’Apple écoutaient régulièrement des enregistrements de moments extrêmement privés, tels que des conversations avec des médecins, des relations sexuelles et d’autres encore. Bien que cette initiative ait été mise en place comme une mesure de contrôle de la qualité, les utilisateurs et utilisatrices ne savaient probablement pas qu’une partie de ce qu’ils prononçaient était enregistré et écouté par des humains.1

Depuis lors, Apple a temporairement suspendu son programme de contrôle humain.2 Google a été contraint de suspendre son propre programme de contrôle dans l’Union européenne et Amazon offre désormais aux utilisateurs et utilisatrices la possibilité de ne pas participer.

Mozilla a élaboré un guide pour vous aider à modifier vos paramètres de vie privée sur les assistants vocaux.

Cliquez ici pour savoir comment modifier vos paramètres et partager l’infographie.

Malgré ces paramètres de vie privée supplémentaires, ces programmes soulèvent toujours un certain nombre de préoccupations qui n’ont pas encore été résolues. Certaines de ces préoccupations sont :

- Pour les utilisateurs et utilisatrices qui n’ont pas refusé l’écoute, les employés d’Amazon et de Google écoutent toujours un petit pourcentage d’enregistrements provenant d’assistants vocaux intelligents. Malgré les efforts déployés pour rendre ces données anonymes, ces enregistrements peuvent contenir des informations sensibles et personnellement identifiables.3

- Dans de nombreux cas, les enregistrements ont été réalisés sans que personne ne prononce le mot déclencheur (« OK Google ») ou parce qu’on a dit quelque chose qui ressemblait au mot déclencheur (comme « Syrie », activant Siri d’Apple). Les gens ne savaient peut-être pas qu’ils étaient enregistrés une fois que l’appareil avait été activé pour écouter.4,5

- Jusqu’aux révélations récentes sur cette question, ces programmes d’analyse n’étaient pas clairement divulgués aux utilisateurs et utilisatrices. Certains, comme Amazon, ne permettaient pas aux personnes de choisir de participer ou non. De plus, de nouvelles informations continuent à être publiées, à savoir que d’autres sociétés, telles que Facebook, ont également recours à l’analyse humaine d’autres types de contenus vocaux sans informer clairement au préalable. Ce qui soulève des questions sur ce à quoi devrait ressembler un consentement significatif quand les données des personnes sont utilisées pour entraîner un modèle qui permet d’améliorer le produit. 6,7

Nous suivrons l’évolution de la question et, bien entendu, nous plaiderons en faveur de plus de transparence et d’une protection renforcée de la vie privée dans des publications telles que notre guide Privacy Not Included, entre autres.

En attendant, il est important que les consommateurs comme vous sachent comment définir les paramètres de confidentialité de leur propre assistant vocal. Pouvez-vous partager cette infographie pour faire passer le mot ?

Merci,

L’équipe Mozilla

Références :

- Alex Hart, « Apple contractors ‘regularly hear confidential details’ on Siri recordings », The Guardian, 26 juillet 2019.

- Taylor Mahlandt, « How to Stop Amazon, Apple, or Google From Listening to Your Smart Speaker Recordings, », Slate, 6 août 2019.

- Sarah Perez, « 41% of voice assistant users have concerns about trust and privacy, report finds » TechCrunch, mai 2019.

- James Vincent, « Yep, human workers are listening to recordings from Google Assistant, too » The Verge, 11 juillet 2019.

- Jeremy Horwitz, « Apple Siri contractors often hear up to 30 seconds of accidental recordings » VentureBeat, 26 juillet 2019.

- Sarah Frier, « Facebook Paid Contractors to Transcribe Users’ Audio Chats », Bloomberg, 13 août 2019.

- Paul Sawers, « Apple and Google halt human voice-data reviews over privacy backlash, but transparency is the real issue », VentureBeat, 2 août 2019.

Traduit par la communauté Mozilla francophone

Vous pouvez vous inscrire aux messages de Mozilla et les recevoir directement dans votre boîte aux lettres électronique.